监控视频所记录的事件繁杂无序、形态各异,且具有显著的非结构化特性,抽象程度高,正负样本比例严重失衡。现有的检测算法在面对这些复杂情况时暴露出诸多短板,如对场景的理解浮于表面,未能充分融入有效的视觉机理,事件表示手段单一僵化,致使在不同场景间的检测泛化能力较弱,难以满足实际应用中的多样化需求。通过模仿人类的感知、推理与决策模式,有机整合环境感知、视觉交互、视觉注意等当下先进技术与理念可显著提升监控事件检测与推理的性能。

团队深入探究环境感知机制,以精准捕捉视频中的环境信息;解析视觉交互原理,阐释画面元素间的内在关联;构建基于视觉注意的事件表示模型,高效聚焦关键事件特征;完善事件推理与检测体系,实现对事件的准确判断;运用半监督学习策略优化跨场景检测能力,使系统能够灵活适应不同的监控场景。在此基础上,提出一套系统全面、逻辑严密的事件表示、关联与推理解决方案,并搭建实景检测平台验证其有效性。本研究方向取得的理论成果与算法突破,为视频监控平台的智能化升级提供坚实的技术基石,有力推动智能安防领域的发展,进而为社会的安全稳定与高效运行保驾护航。

在研究推进过程中,团队形成了ReferDance和BUPTCampus数据集,以期携手国内外研究人员共同推进该领域的快速发展。

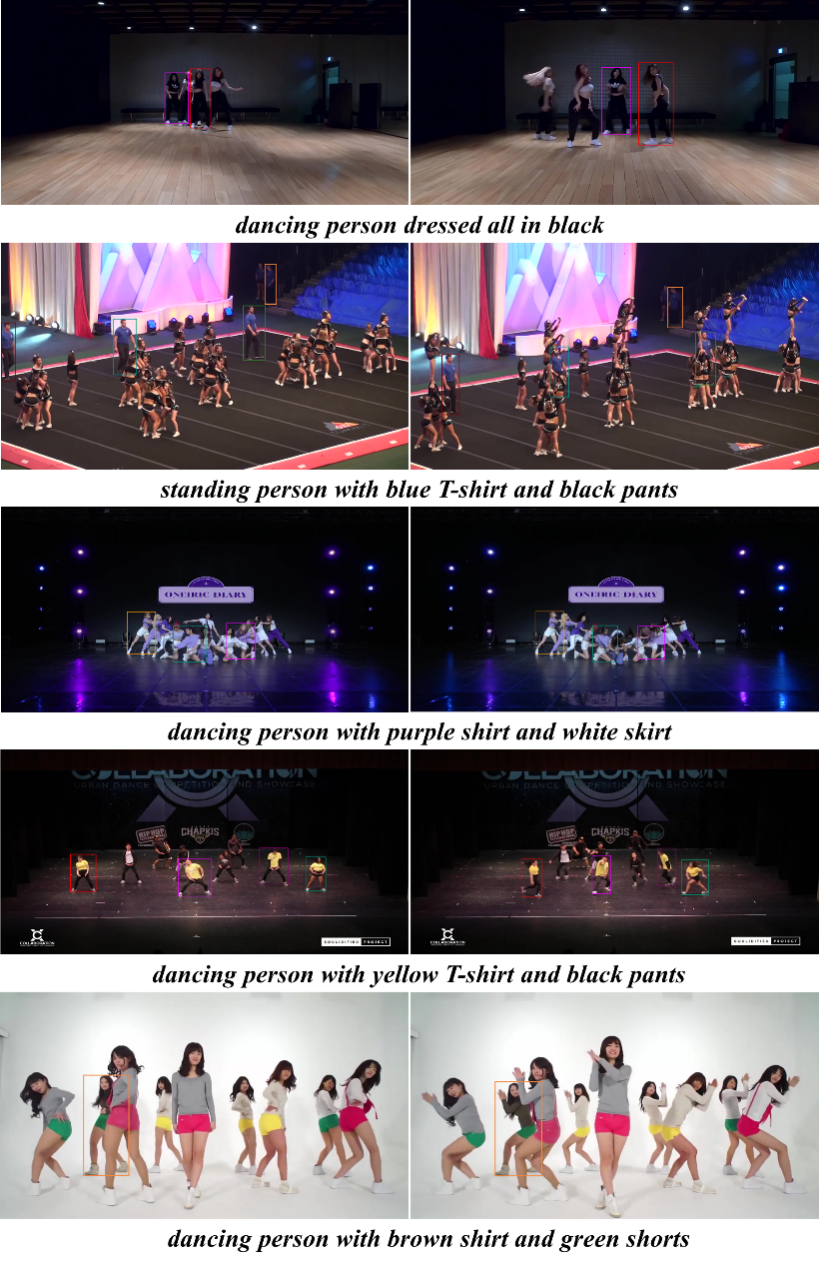

(1)ReferDance 数据集: 用于多目标跟踪,旨在通过输入的描述跟踪对应的物体,包含视频及手动注释的文本描述,评估指标包括 HOTA、MOTA 和 IDF1。

点击获取数据并了解更多细节

点击获取数据并了解更多细节

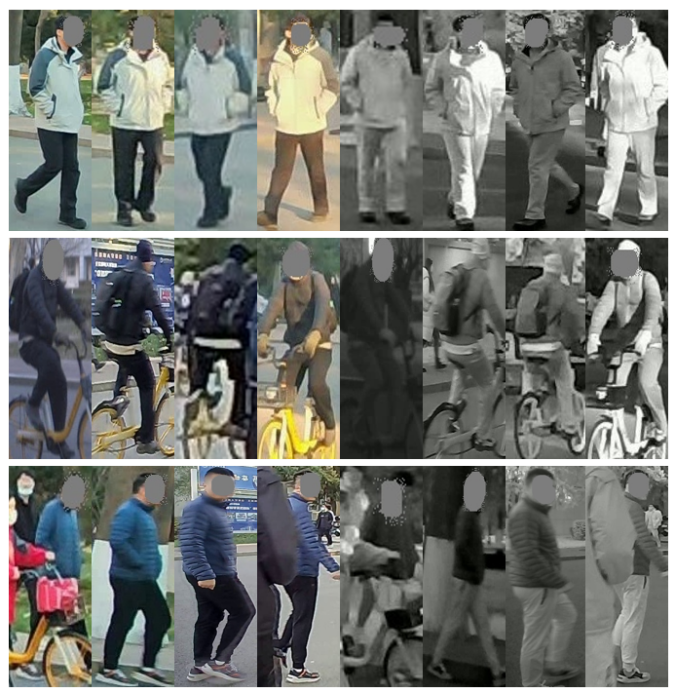

(2)BUPTCampus 数据集: 用于视频基于可见光-红外的人物重识别,采用双目双模摄像机同步捕捉 RGB 和红外视频,并结合多目标跟踪和人工修正进行标注。

点击获取数据并了解更多细节

点击获取数据并了解更多细节